1. 서론

3차원 영상 내지 동영상 기술의 저변은 우리가 공부했던 2차원 요소들의 그야 말로 차원의 확장에서 비롯됨을 알았으며, 2차원 영상에 비해 표준화 등 이 아직 미비한 수준으로 향후 영상 발전의 지표로써 연구의 큰 의미를 두고 있었다. 이런 중요성을 감안하여 국가 차원에서도 3차원 기술의 선점을 위한 연구, 개발로 각 나라에서는 소리 없는 전쟁이 치열한 분야라는 느낌을 받을 수 있었다.

우리들의 눈은 가로 방향으로 약 65mm 떨어져서 존재하는데, 이로 인해 나타나게 되는 양안시차는 입체감의 가장 중요한 요인이라 할 수 있다. 즉, 좌우의 눈은 각각 서로 다른 2차원 화상을 보게 되고, 이 두 영상이 망막을 통해 뇌로 전달되며, 뇌는 이를 정확히 서로 융합하여 본래 3차원 입체 영상의 깊이감과 실제감을 재생하는 것이다. 우리가 실제 눈으로 얻는 정보는 입체영상이어서 눈과 귀만의 정보가 아닌 입체감과 현실감이라는 느낌의 정보까지도 포함한 대용량의 입체영상 정보이므로 현재 디지털케이블이나 광대역통합망과 같은 초고속 정보통신망을 통하여 3차원 비디오를 서비스하기 위한 시도가 이루어지고 있다.[1]

일반적으로 3차원 영상이란 의미에서 단순히 배경과 주객체의 원근감을 생각할 수 있었다. 어렸을 때 공책에 받쳐 쓰던 책받침에 흔히 볼 수 있었던 만화 영화 캐릭터 3D 화면에 마냥 신기해했던 기억과 놀이 공원의 특수 안경을 쓰고 봤던 입체 영상 영화 등이 3D 영상을 접할 수 있는 전부였다. 그러나 이러한 3차원 영상을 만들어 내기 위한 방법에도 양안식, 다시점, 홀로그램 등 여러 방법으로 시도 되고 있었다. 이런 비디오 관점들과 3D 비디오 부호화를 이해하기 위한 선행 지식과 동향 등 개요에 대해서 2장에서 살펴 볼 것이며, 3장에서는 3D 영상의 변이예측, 차 영상 부호화 등 3D 동영상을 이루는 화면 내 부호화에 대해서 알아본다. 4장에서는 3D 비디오를 처리 하는 부호화 과정을 예측 구조와 예측 방법으로 나누어 살펴 볼 것이며, 5장에서의 결론으로 맺는다.

2. 3D 비디오 개요

3차원 비디오 처리기술은 차세대 정보통신서비스의 총아로 사회 선진화와 더불어 수요 및 기술 개발 경쟁이 치열한 첨단의 고도화 기술로서 정보통신, 방송, 의료, 교육 훈련, 군사, 게임, 애니메이션, 가상현실, CAD, 산업기술 등 그 응용 분야가 매우다양하며 여러 분야에 공통적으로 요구되는 차세대실감 3차원 입체 멀티미디어 정보통신의 핵심 기반기술로서, 이에 대한 연구가 선진국을 중심으로 활발히 진행되고 있다.

3차원 비디오를 정의하는 데 있어 두 가지 관점이 있다. 첫 번째는 영상에 깊이 정보를 이용하여 영상의 일부가 화면으로부터 튀어나오는 느낌을 사용자가 느끼도록 구성된 비디오를 말하며, 두 번째는 기본적으로 사용자에게 다양한 시점을 제공하여 현실감을 느끼도록 구성된 비디오를 말한다. 현재 3차원 비디오는 획득, 표현, 깊이감, 디스플레이에 따라 <표 1>과 같이 분류할 수 있다. 3차원 비디오는 표현방식에 따라 양안식, 다안식, IP, 옴니, 파노라마, 다시점, 홀로그램 등으로 분류할 수 있으며 각각 다음과 같이 정의되어 진다.

① 양안식 비디오: 좌안영상과 우안영상만으로 표현된 3차원 비디오

② 다안식 비디오: 양안식 또는 다시점 획득시스템으로부터 얻어진 복수 개의 영상으로 구성되어진 3차원 비디오

<표 1>3차원 비디오 분류

| 획득 | 표현 | 깊이감 | 디스플레이 | |

| 양안식 획득 시스템 | 양안식 비디오 | o | 셔터링, 편광, 렌티큘러, 패럴렉스베리어, HMD | |

| 다안식 비디오는 양안시/다시점 획득 시스템과 공유 | o | 렌티큘러, 패럴렉스베리어 | ||

| 다시점 획득 시스템 | IP(Integral Photography) 비디오 | o | IP 렌즈 어레이 | |

| 다시점 비디오 | 옴니 비디오 | x | 일반 모니터 | |

| 파노라마 비디오 | x | 일반 모니터 | ||

| 홀로그램 획득 시스템 | 홀로그램 비디오 | o | 렌티큘러, 자유공간 | |

③ IP 비디오: 수평 및 수직방향으로 깊이감을 제공하는 3차원 비디오

④ 다시점 비디오: 한 대 이상의 카메라를 통해 촬영된 영상들을 기하학적으로 교정하고 공간적인 합성 등을 통하여 여러 방향의 다양한 시점을 사용자에게 제공하는 3차원 비디오

⑤ 옴니 비디오: 다시점 비디오 방식으로 옴니 카메라를 이용하여 상/하, 좌/우, 전/후의 전방향의 영상으로 구성된 3차원 비디오

⑥ 파노라마 비디오: 다시점 비디오 방식으로 장면에 대한 일련의 영상들을 획득한 후 이를 결합하여 사용자에게 다양한 시점의 영상을 끊김없이 제공하기 위해 합성된 3차원 비디오

⑦ 홀로그램 비디오: 빛의 세기뿐만 아니라 파동으로서의 빛이 갖는 위상정보까지 포함함으로써 원래의 3차원 상을 정확히 재현할 수 있도록 구성된 3차원 비디오[1]

3. 3차원 영상 부호화

본 보고서에서는 두 시점의 스테레오 영상 부호화에 대해서 알아본다.

스테레오 영상 압축 방법 중 가장 많이 사용되고 있는 방법이 변이 추정을 이용한 방법이다. 이 방법은 스테레오 영상 쌍 중 기준이 되는 영상을 독립적으로 부호화하고, 다른 영상은 기준이 되는 영상에서의 변이를 추출 후 이를 보상하는 방식이다. 추정 후 추정된 영상과 실제 영상의 차이를 구하게 되고, 여기서 구해진 차이 영상이 오차영상(residual image)이 된다.

이렇게 함으로써 스테레오 영상의 높은 공간적 중복성을 제거하고, 변이추정을 거쳐 나오는 변이 벡터를 수신단에 전송하여 추정된 변이 벡터를 통해 예측된 값과 실제 영상의 차이를 변환 부호화해서 높은 압축 효율을 얻을 수 있다. 그림 1은 변이 보상 방법을 블록 다이어그램으로 표시한 것이다.[6]

3.1 변이 추정 (Disparity Estimation)

변이 추정이란, 스테레오 영상의 좌,우 영상이 공간적 상관성이 매우 높다는 점을 이용하여 서로 대응되는 점 또는 영역을 찾아내는 과정이다. 이렇게 함으로써 두 영상간의 공간적 중복성을 제거하고 압축효율을 높이는 방식이다. 스테레오 영상 압축에 관한 논문은 단안 영상이나 동화상 압축에 비해 매우 드문 편이다. 그리고 그 중 대다수의 논문들이 변이 추정의 성능을 높이는 방법에 초점을 맞추고 있다. 변이추정은 그 추정 방향에 따라 순방향 추정(forward estimation)과 역방향 추정(backward estimation)으로 나누어 볼 수 있다. 스테레오 영상 중 좌영상을 기준영상으로 정했을 때, 순방향 추정은, 좌영상을 분할 또는 특징점을 추출 한 후, 우영상에서 가장 유사한 영역을 찾아 좌영상으로 우영상을 추정해 내는 방식이다. 반대로, 역방향 추정은 생성할 영상인 우영상을 분할하거나 특정점 추출 후 기준 영상에서 이의 정합점을 찾아나가는 방식이다. 정방향 추정의 겨우 좌영상의 분할 영역정보 혹은 특징점에 관한 정보 없이, 변이 정보만 전송하면 수신단에서 수신된 죄영상을 이용하여 송신단에서와 같은 알고리듬으로 분할 영역 정보나 특징점 정보를 동일하게 찾아낼 수 있어 압축효율을 높일 수 있는 장점이 있지만 송신단에서 계산량이 증가하고 기준영상이 올바르게 복원되지 못했을 경우 오차가 영상전체에 퍼져나타나게 되는 단점이 있다. 반면에 역방향 추정의 경우에는 수신단의 복호화 과정이 간단한 대신 분할 영역이나 특징점들에 관한 정보를 함께 전송해야 하므로 압축율이 낮아지게 된다. 여기서는 일반적으로 사용되는 시차추정 방법 중에서 블록 기반, 객체 기반, 망 기반 방식에 대하여 알아보도록 하겠다.

(1) 블록기반 변이추정(BIOCK-based Disparity Estimation)

블록 기반 방식은 영상을 고정크기, 혹은 가변 크기의 블록으로 나누어 변이를 추정하는 방식이다.

이는 MPEG-1/2, H.261. H.263 등의 영상 압축 표준에서 16(16의 매크로 블록 (macro block; MB)단위로 움직임 추출 시 사용되는 기법과 동일하다. 스테레오 영상 중 한 영상을 블록 단위로 나누어 다른 한 영상에서 비용 함수(cost function)를 만족하는 위치를 찾아 이 이동량을 그 블록의 변이 값으로 결정한다. 비용함수는 일반적으로 MAE, MSE, NTD, 상관도(cross correlation) 등이 있다. 하지만 MSE의 경우에는 하드웨어적으로 제곱연산 구현의 복잡성 때문에 잘 활용되지 않고 있다. 아래 식은 블록정합 방식에서 비용함수를 MAE를 이용했을 때의 식이다.

여기서,Ir은 예측하고자 하는 영상이고, Ii은 참조영상을 말한다. 먼저, 예측 추정하고자 하는 영상을 N(M 크기의 블록으로 분할 수, 검색구간 내에서 최소의 MAE(mean absolutetrror)를 얻는 블록이 가장 상관도가 높은 블록으로 판별된다.

그림 2는 두 장의 스테레오 영상에서 좌영상을 기준 영상으로 하고 우영상의 탐색 구간 내에서 최대 매칭 블록을 찾아내는 과정이다. 위의 설명에서는 기준 블록의 변이가 수직, 수평 성분을 모두 가지는 경우이고, 일반적이 스테레오 영상에서는 스테레오 카메라가 병렬로 놓여있다고 가정하기 때문에 수평시차만 고려하여 계산 시간을 단축하는 경우도 있다. 블록기반 변이 추정방법은 구현이 간단하다는 장점이 있지만 블록의 크기와 탐색범위에 따라 변이추정 결과에 많은 영향을 미친다. 즉, 블록의 크기가 커지면 다른 깊이를 가지는 물체가 동시에 블록 내에 존재 할 수 있으므로 변이 벡터를 부정확해지고 블록화 현상이 일어날 수 있으며, 블록의 크기가 작으면 세밀한 변이 벡터를 얻을 수 있는 반면, 일치점이 중복되어 신뢰도가 감소한다. 탐색범위가 넓어지면 여러 후보 블록 중에서 대응 블록을 찾을 수 있지만 계산량이 증가하여 실시간 처리에 힘든 단점이 있다. 반면에 탐색범위가 적어지면 변이 벡터의 정보량이 감소하고, 검색시간을 줄일 수 있지만, 예측된 영상의 화질열화 현상이 발생한다.

이러한 블록의 크기와 탐색범위로 인한 잘못된 변이 추정을 보완하기 위해 Sathurama는 가변블록을 기반으로 하는 변이 추정방법을 제시하였다. 그는 일정한 밝기 값을 가지는 영역끼리 분할하여 각 영역의 변이를 추정하는 방법을 사용하여 경계와 가려진 영역에서도 비교적 정확한 변이추정이 가능하게 하였지만, 하지만 분할된 블록의 크기가 각각 다르기 때문에 이에 대한 부가적인 정보를 전송하여야 하는 단점이 있다. 또한 Tzovaras와 Strintzis는 계층적 블록 정합방식(hierarchical BMA :HBMA)을 이용하여 탐색범위를 한정하여 수행시간을 단축시키는 방법을 제시하였다. 이 방법에서는 좌, 우 영상을 웨이블릿패킷 (wavelet packet) 분해하여 각각 저역 통과 필터와 다운 샘플링 과정을 통한 후 각각 다른 해상도의 영상을 얻는다. 최저해상도의 영상에서 변이 추정을 시작하여 초기 변이 벡터를 구하고, 이때 계산된 변이 벡터는 한 단계 고해상도 영상의 변이 벡터의 초기 값이 되어 이를 기준으로 다시 변이 추정을 하여 점차 높은 해상도의 영상으로 옮겨가면서 최종적인 변이추정을 하게 된다. 이때 한 단계 고해상도로 옮겨지면서 탐색범위를 한정하여 수행시간을 단축시킬 수 있다.

Kim과 Ahn은 FS(Full Search)방법의 변형으로 검색 시 방향성과 검색구간에 제한을 두어 계산 효율을 증가시키는 ADLS(adaptive directional,limited search)라는 방법을 제시하였다. 이들은 스테레오 영상의 특징 중, 왼쪽영상을 기준 영상으로 하고 순방향 변이 추정을 할 때 대다수의 변이벡터가 왼쪽으로 이동 한다는 점에 착안하여 검색 방향의 우선순위와 이웃블록과의 변이 연속성을 이용하여 변이 추정의 효율적인 계산을 제안 하였다.

(2) 특징 기반 변이추정

블록 기반 변이 추정방식은 두 영상에서 화소들이 밝기 값으로 대응블록의 변이를 찾는다. 화소들이 밝기 값만 가지고 대응블록을 찾으면 카메라의 광도변화나 물체의 경계 부분에서 블록기반 변이 추정방식은 효율이 떨어진다. 특징기반 변이 추정방식은 밝기 값 대신 영상의 특징을 사용하여 대응블록을 찾는 방식이다. 이때 사용되는 영상의 특징으로는 영점 교차의 부호 경도의 첨두(gradient peak), 영역(region), 선(line), 경계(edge) 등이 있다. 위의 특징들은 정합을 위해 독립적으로 사용되기도 하지만 블록 정합 방식과 같이 물체 윤곽에 따른 변이의 연속성이나 이웃 블록의 변이 연속성에서 제약이 가해지는 정합 방식의 단점을 보완하기 위해 같이 쓰는 경우도 있다. Kim과 Shon은 블록기반 변이추정 방식에서 변이 지도의 연속성과 정보량의 감소를 위해 주변블록과 변이벡터를 평활화하는 방법을 사용하였는데 이때, 경계영역에서는 그 방향으로는 변이를 평활화하지 않는 경계보존 방향성 평활화 방식을 제안하여 블록기반 변이 추정 방식과 특징 기반변이 추정 방식을 접목시킨 알고리듬을 제시하였다.

(3) 그 밖의 변이추정 방식

그 밖의 시차 추정 방식으로는 메쉬기반, 객체 기반 시차 추정방식 등이 있다. 이들 방식들은 블로기반 시차 추정 방식의 단점을 보완하고자 제안된 방법 들이다. 메쉬 기반변이 추정 빙식은 변이차가 있는 물체를 블록이 아닌 임의의 형태로 분할하여 각분할 영역에 대해 평행 이동만으로 변이를 보상하는 대신 회전, 확대 축소, 변형 등의 변이를 처리하는 공간변환을 채택하여 변이를 보상하나. 즉, 영상을 다각형 조각(polygonal patch)으로 나누어 다각형 조각의 꼭지점들을 중심으로 이동점을 찾아 변이를 추정하는 방식을 메쉬 기반 변이 추정 방식이라 한다. 메쉬 가반방식은 메쉬의 형태를 결정하는 특정한 과정이 필요하며, 절점 정보만으로 불규칙 삼각망을 생성하는 알고리듬인 델로니 삼각망(delaunay

-trangulation) 형성 방식이 대표적이다.

객체기반 방식은 영상이 독립적인 객체의 조합으로 이루어져 있다는 가정 하에 영상을 객체단위로 분할하여 변이를 추정하는 방식이다. 즉, 영상을 유사한 특성을 갖는 영역으로 분할하여, 분할된 영역에 대하여 변이를 찾고, 이와 함께 윤곽선을 부호화 하여 전송한다. 객체단위로 변이를 추정할 경우, 블록화 현상이 발생하지 않으며 영상을 객체단위로 접근하는 것이 가능하므로 적합하고, 객체 형태 등의 추가정보를 전송해야 하며, 객체가 세분화될 경구 객체 형태를 위한 데이터량이 증가하는 단점이 있다. 객체 기반 방식에는 영상 분할을 통해 VOP(vidio object plane)를 추출한 후, 각 VOP에 대한 윤곽선과 텍스쳐를 부호화하여 전송하는 방식이 적용된다.

3. 2차 영상 부호화

좌, 우 두 개의 영상이 동시에 전송되어야 하는 스테레오 영상 통신에서는 먼저 좌, 우 영상의 공간적 상관성을 이용한 변이 추정 및 보상을 하게 된다. 추정된 변이와 함께 예측된 영상과 원 영상과의 차 영상을 전송하여 효율적인 전송을 하게 된다. 특히 차 영상은 가려진 영역의 정보를 가지고 있기 때문에 그 정보는 인간의 눈이 입체로 느끼는데 꼭 필요한 정보를 포함하고 있다. 따라서 입체 영상 시스템에서 차 영상이 차지하는 비중 또한 크다고 할 수 있다. 차 영상 부호화는 일반적으로 DCT를 기반으로 하는 JPEG 표준 알고리즘이나 웨리블릿을 이용하여 부호화 한다.

4. 다시점 비디오 예측 부호화

지난 2005년 1월 MPEG 표준화 회의에서 CfE(Call for Evidence)에 대한 결과로 발표되었던 여러 기법들을 간단히 소개한다. 크게 예측 구조와 예측 방법으로 나눌 수 있다.[7]

4-1.예측 구조

(1)GoGOP(Group-of-GOP)

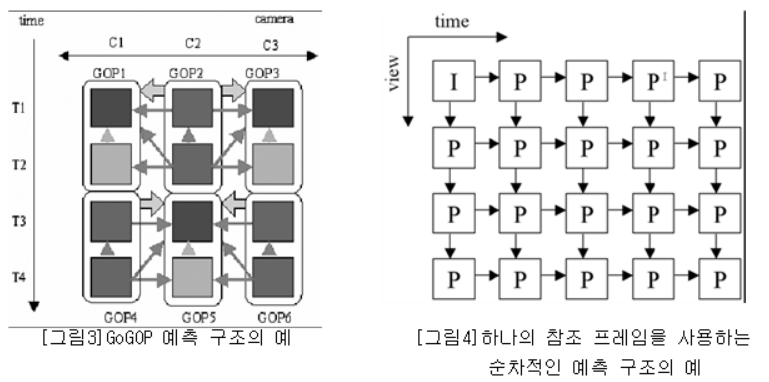

GoGOP는 그림3과 같은 예측 구조를 가지며, 모든 GOP는 BaseGOP와 InterGOP 두 가지로 나뉘는데, BaseGOP의 픽쳐는 현재 자신의 GOP내에서만 예측한다. 반면에 InterGOP는 현재 자신의 GOP는 물론 이미 코딩/디코딩된 다른 GOP까지 참조하여 예측한다. 이 예측 구조는 낮은 지연임의 접근도 가능하다 그림3에서는 GOP1과 GOP3, GOP5가 BaseGOP이고 GOP2, GOP4, GOP6이 InterGOP이다.

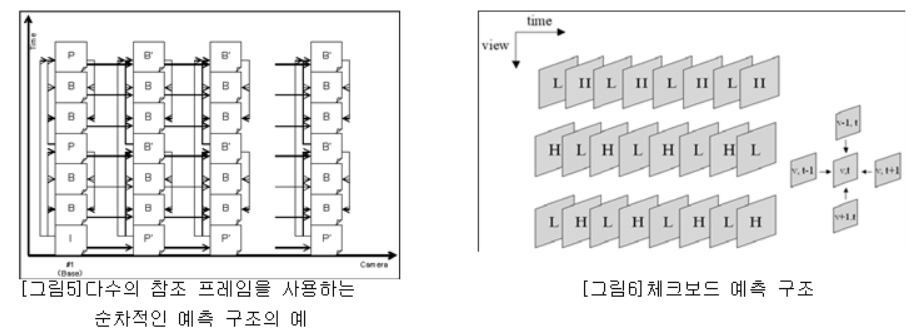

(2)순차적인 시점 예측

그림4에서는 순차적인 시점 예측구조를 나타내고 있는데, 첫 번째 시점(카메라)은 규칙을 따라서 시간적 예측을 통해 코딩되고, 다른 시점은 시간적인 예측과 함께 같은 시간 축에 있는 바로 이전 시점의 영상에서도 예측하여 코딩한다. 그림5에서는 다수의 참조 프레임을 사용하는 순차적인 예측 구조를 나타내는데, 다음의 5가지의 프레임 타입이 있다.

■ I : Intra 프레임

■ P' : 다른 시점에서 예측 가능, 참조 프레임으로 I또는P'만을 사용

■ P : 현재 시점에서 예측 가능, 참조 프레임으로 I또는 P만을 사용

■ B' : 현재 시점과 다른 시점에서 모두 예측가능, 참조 프레임으로,P,P',B'을 사용

■ B : 현재 시점과 다른 시점에서 모두 예측 가능, 참조 프레임으로 P,P',B',B를 사용

(3)체크보드 예측 구조

그림6에서처럼 짝수/홀수 번째 비디오는 저주파수 영역 통과 필터를 사용하고 홀수/짝수 번째 비디오는 고주파수 영역통과 필터를 사용하여 코딩을 하는 구조이다.

4-2.예측 방법

(1)프레임 기반 색상 보정

먼저 프레임 Ln를 코딩하기 전에, Ln-1프레임의 코딩/디코딩된 프레임과 원래 Ln프레임의 색상 채널에 대하여 각각의 평균을 계산한다. 그리고 그 평균의 차이만큼 코딩/디코딩된 Li-1프레임을 이동 시켜 프레임 기반으로 색상차이를 보정해주는 방법이다. 이 방법을 적용하여 평균 0.1-0.2dB의 화질 향상을 보였다.

(2)블록 기반 조명 변화에 적응적인 움직임 예측 및 보상

같은 시점 내에서나 다른 시점과의 프레임간의 조명변화가 일어나면 기존의 방법으로는 정확한 움직임 예측 및 보상이 수행되지 않는 점에서 착안한 이 방법은 현재 블록과 참조 블록의 화소 평균값을 구하여 각 화소 값에서 그 블록의 평균 화소값을 뺀 다음, 다시 그 차분을 구해 움직임 예측을 하는 것이다.

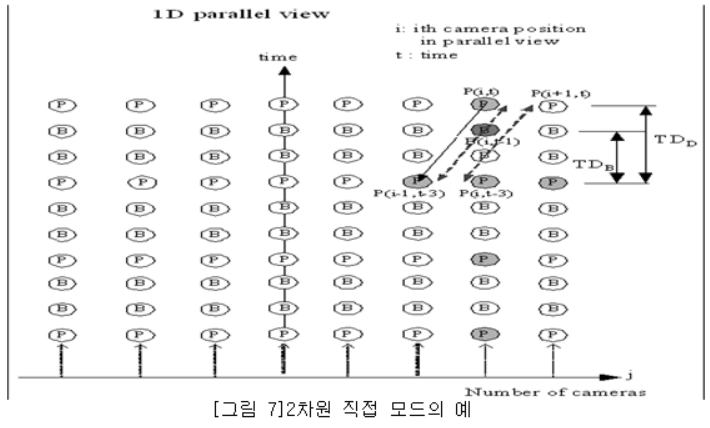

(3)2차원 직접 모드

그림7과 같이, 이 방법은 B프레임 코딩 시에 기존의 시간적 직접 모드를 다른 시점을 참조하는 P프레임에서는 예측이 안 되는 것을 보완, 수정하여 다른 시점간의 직접모드를 가능하게 하였다.

(4)디스패리티/움직임 벡터 예측

이전 프레임에서 코딩할 때 사용했던 디스패리티/움직임 벡터를 재사용하여 현재 프레임 코딩 시 디스패리티/움직임 벡터의 오버헤더를 줄여 효과적으로 코딩하게 하는 방법이다.

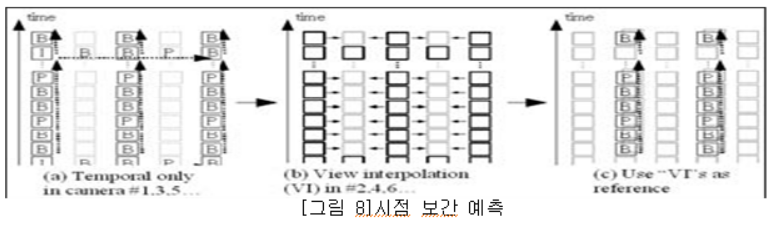

(5)시점 보간

그림8에서 처럼 우선 1,3,5,...번째 카메라의 비디오를 MPGE-4 AVC로 (a)처럼 코딩 한 다음, 그 사이의 카메라인 2,4,6,...번째 카메라의 비디오를 1,3,5,...번째 카메라의 코딩된 비디오에서부터 (b)와 같이 보간을 한다. 그리고 그 보간된 프레임을 참조 프레임으로 추가하여 (c)에서 처럼 코딩하여 코딩효율향상을 기대하는 것이다.

5. 결론 및 의견

본 보고서에서는 3차원 비디오를 표현 방식에 따라 분류하고, 그 중 다시점, 즉 여러 대의 카메라를 이용하여 사용자들에게 자유로운 시점 및 넓은 화면을 통한 입체감을 제공하는 방식의 부호화 방법들을 살펴보았다. 그리고 3차원 비디오의 이해를 돕기 위해 3차원 영상의 부호화 방식에 대해서도 살펴보았다.

우선 3차원 영상 부호화에서는 기본적인 임직임 추정 및 예측 방식은 2차원의 방식과 차이가 없으나 2개의 시점, 즉 카메라가 2대가 동원된 부호화 방식의 경우 두 영상 쌍의 공간적 중복성을 제거하기 위한 노력이 필요해 보였다. 이를 위하여 변이 추정과 보상이란 방식을 사용하며 아울러 우리가 공부했던 DCT나 웨이블릿을 통해 차 영상을 부호화 하게 된다. 특히 흥미로운 것은 차 영상의 경우 3차원의 특성상 가려진 영역의 정보를 가지고 있고 반드시 필요한 정보를 포함하므로 그 비중이 상당히 크다는 것이었다.

다시점 3차원 동영상 부호화에서는 차세대 디지털 TV분야에 해당하는 3DAV(3D Audio Video) 기술 발전과 맥을 같이 하고 있는 듯했다. 방송 분야에서 고화질의 HD 방식을 대처할 차세대 영상 기술로 비상한 관심을 가지는 분야이기도 한다. 3D 동영상에서 특히 고려 되여야 할 점은 그 정보량이 2차원의 그것과 비교해 상당히 방대해 지므로 고속 대용량의 정보통신 인프라 구축과 주변 기반 기술의 발전을 동반하여야 한다는 것이다.

3차원 다시점 비디오 신호 부호화기의 기본 구조는 기존의 움직임 추정 부호화 과정으로 구성된 2차원 비디오 신호 부호화기 구조에 다시점 비디오 신호의 변이 추정 및 부호화 과정이 추가되며 필요에 따라서는 움직임 정보와 변이 정보를 동시에 이용한 joint 변이/움직임 추정 및 부호화 과정이 사용되는 구조였다.

영상 기술의 발전 과정을 언급할 때 방송 기술과의 연계성을 따지지 않을 수 없을 것이다. 방송 기술은 현재 CD급 음질과 선명한 고화질을 제공하는 HDTV에서 3차원 입체TV 형태로 발전해 나가고 있다. 공상 과학 영화에서는 나오던 일들이 현실이 되어가고 있으며, 그 시기 또한 멀지 않음을 알 수 있었다. 현재 선진국들의 움직임이 3차원 영상 분야에 활발하며, 단지 그 가능성만을 확인한 단계를 벗어나고 있다면 우리나라의 영상 기술 발전의 방향 역시 3차원 영상 기술에 좀 더 많은 노력을 경주해야 할 것이란 생각이다.

[참고문헌]

[1]강훈종, 김대희, 윤국진, 조숙희, 안충현, "3차원 비디오 처리 기술 동향" 2004년 8월 전자통신동향분석 제19권 4호

[2]김성식, "3차원 영상 디스플레이 기술의 조류" 2001년 광학과 기술 제5권 2호

[3]성우철, 이영렬, "3차원 비디오 압축에서의 다시점 부호화를 위한 적응적 시공간적 예측 부호화" 2004년 방송공학회지 제9권 3호

[4]손광훈, 임정은, "3차원 영상 부호화 기술" 2001년 광학과 기술 제5권 3호

[5]손정영, 천유식, "3차원 영상기술 현황 및 전망" 2001년 광학과 기술 제5권 2호

[6]유지상, 김은수, 배진우, 이병진, "3차원 스테레오 영상 부호화 기법" 2001년 3월 방송공학회지 제6권

[7]이영렬, 이융기, "3DAV(3-Dimensional Audio Video) 기술동향" 2005년 9월 전자공학회지 제32권 9호

[8]조성환, 김응성, "DCT와 계층 분할 벡터 양자화를 이용한 3차원 영상 부호화" 2005년 4월 한국 인터넷 정보학회지 제6권 2호

'정보과학 > 영상통신시스템' 카테고리의 다른 글

| 고속 퓨리에 변환 프로그램 구현 (1) | 2023.10.18 |

|---|---|

| (토론)H.264의 움직임 추정 기법 (1) | 2023.10.18 |

| (토론)영상 변환 기법과 예측 부호화 (1) | 2023.10.18 |

| (토론)영상 부호화와 멀티미디어 서비스 (1) | 2023.10.18 |

| (토론)시간적 데이터 중복 (1) | 2023.10.18 |